Mercury Coder

Mercury Coder est un modèle de langage de grande taille innovant développé par Inception Labs, qui utilise la technologie de diffusion (Diffusion Technology) au lieu de méthodes autorégressives traditionnelles pour générer du code et du texte de haute qualité à plus de 1000 tokens par seconde. Il excelle dans la génération de code, le traitement de contextes très longs, avec un coût faible et une efficacité élevée, rivalisant avec GPT-4o Mini et Claude 3.5 Haiku dans les tests de référence. Il est actuellement disponible gratuitement via un Playground en ligne, idéal pour les développeurs souhaitant créer rapidement des prototypes, et pourrait s'étendre à plus de scénarios à l'avenir, représentant une nouvelle direction des technologies de l'IA.

Détails du site

Qu'est-ce que Mercury Coder ?

Mercury Coder est un outil d'intelligence artificielle conçu pour aider les développeurs, les utilisateurs professionnels et les chercheurs à générer du code, à traiter des tâches complexes ou à effectuer des dialogues longs de manière plus efficace. Contrairement aux modèles de langage traditionnels (comme GPT ou Claude) qui génèrent des mots un par un (méthode dite « autorégressive »), il utilise une nouvelle approche basée sur les modèles de diffusion (Diffusion Model). Cette méthode, d'abord appliquée avec succès dans le domaine de la génération d'images (comme Stable Diffusion), a été innovantement adaptée à la génération de texte et de code.

En résumé, les caractéristiques principales de Mercury Coder sont sa rapidité, sa qualité élevée et son coût bas. Il peut générer une grande quantité de code ou de texte en quelques secondes, même à plus de 1000 tokens par seconde, dépassant largement la plupart des modèles existants.

Comment fonctionne Mercury Coder ?

Pour comprendre le fonctionnement de Mercury Coder, il faut d'abord expliquer la différence entre les modèles traditionnels et les modèles de diffusion.

Modèles autorégressifs traditionnels

Imaginons que vous écriviez un article, mot par mot, en déterminant chaque mot suivant avant de passer au suivant. Cette méthode s'appelle « autorégressive » (Autoregressive). Par exemple, ChatGPT fonctionne ainsi : il prédit chaque mot de gauche à droite, sa vitesse étant limitée par le processus « pas à pas ». Si la tâche est longue (par exemple, générer 1000 mots), il prend plus de temps car chaque étape doit attendre la précédente.

Modèles de diffusion (méthode de Mercury Coder)

Pensons à un autre scénario : vous avez une image floue avec l'empreinte d'un chat. Vous effacez progressivement le flou pour obtenir une image claire du chat. C'est l'idée de base des modèles de diffusion : partir de « bruit » (un désordre) et l'éliminer progressivement pour obtenir un résultat clair.

Mercury Coder applique cette logique au texte. Au lieu de générer un mot après l'autre, il commence par créer un brouillon grossier (une série de mots désordonnés), puis l'ajuste plusieurs fois (étapes d'élimination du bruit) pour rendre le texte ou le code clair et utilisable. Cette méthode de traitement parallèle lui permet de générer rapidement de grandes quantités de contenu, contrairement aux modèles traditionnels qui génèrent séquentiellement.

Par exemple, si vous lui demandez d'écrire un programme de 500 lignes, un modèle traditionnel produirait « de la ligne 1 à la ligne 500 », tandis que Mercury Coder créera d'abord un cadre global, puis remplira les détails d'un coup, ce qui accélère nettement le processus.

Qu'est-ce qui rend Mercury Coder unique ?

Selon les informations officielles et les tests publics, Mercury Coder présente plusieurs atouts :

Vitesse extrême

- Sur une GPU NVIDIA H100 standard, Mercury Coder Mini atteint 1109 tokens par seconde, tandis que Mercury Coder Small atteint 737 tokens. En comparaison, GPT-4o Mini ne fait que 59 tokens/seconde, et Claude 3.5 Haiku seulement 200 tokens/seconde. Cela signifie qu'il est 5 à 10 fois plus rapide que les modèles dominants, voire 20 fois plus rapide que certains modèles avancés.

- Pourquoi si rapide ? Les modèles de diffusion ne sont pas limités par la génération séquentielle, contrairement aux modèles autorégressifs, et peuvent travailler en multithread.

Résultats de haute qualité

- Dans les tests de référence (comme HumanEval, MBPP), Mercury Coder se comporte comme GPT-4o Mini ou Claude 3.5 Haiku, parfois même mieux. Par exemple, Mercury Coder Mini se classe parmi les meilleurs dans les tests de préférences des développeurs sur Copilot Arena.

- Il peut également corriger ses erreurs (via l'optimisation répétée dans l'élimination du bruit), réduisant ainsi les « hallucinations » (contenu erroné généré par l'IA).

Capacité aux contextes très longs

- Mercury Coder excelle dans le traitement de textes très longs ou de tâches complexes, comme la génération d'un programme complet ou des dialogues multirondes. Cela s'explique par sa capacité à optimiser l'ensemble de la sortie, plutôt que de se concentrer sur les premiers mots.

Coût réduit

- Grâce à sa rapidité et son efficacité, les coûts de calcul pour exécuter Mercury Coder sont bien plus bas que ceux des modèles traditionnels. Cela est particulièrement important pour les utilisateurs professionnels, permettant d'économiser des coûts serveur.

Flexibilité

- Il ne se limite pas à la génération de code, mais peut aussi être utilisé pour le chat ou la génération de texte. Bien que la génération de code soit son atout principal, il pourrait s'étendre à d'autres domaines à l'avenir.

Comment Mercury Coder se compare-t-il aux autres modèles ?

Pour vous donner une idée plus claire, voici une comparaison simple entre Mercury Coder et plusieurs modèles connus :

| Modèle | Méthode de génération | Vitesse (tokens/s) | Domaines de prédilection | Coût |

|---|---|---|---|---|

| Mercury Coder | Modèle de diffusion | 737-1109 | Génération de code, textes longs | Faible |

| GPT-4o Mini | Autorégressive | 59 | Dialogues, code | Moyen |

| Claude 3.5 Haiku | Autorégressive | 200 | Textes, code | Moyen |

| DeepSeek Coder V2 | Autorégressive | Non communiqué (rapide) | Génération de code | Moyen |

- Vitesse : Mercury Coder domine clairement grâce à l'avantage parallèle des modèles de diffusion.

- Qualité : Il se rapproche des meilleurs modèles dans la génération de code, mais perd parfois face à DeepSeek Coder V2 Lite (un modèle spécialisé en code).

- Application : Mercury Coder est plus orienté vers la génération de code pour l'instant, avec une polyvalence inférieure à celle de GPT ou Claude, mais un grand potentiel.

Comment l'utiliser en pratique ?

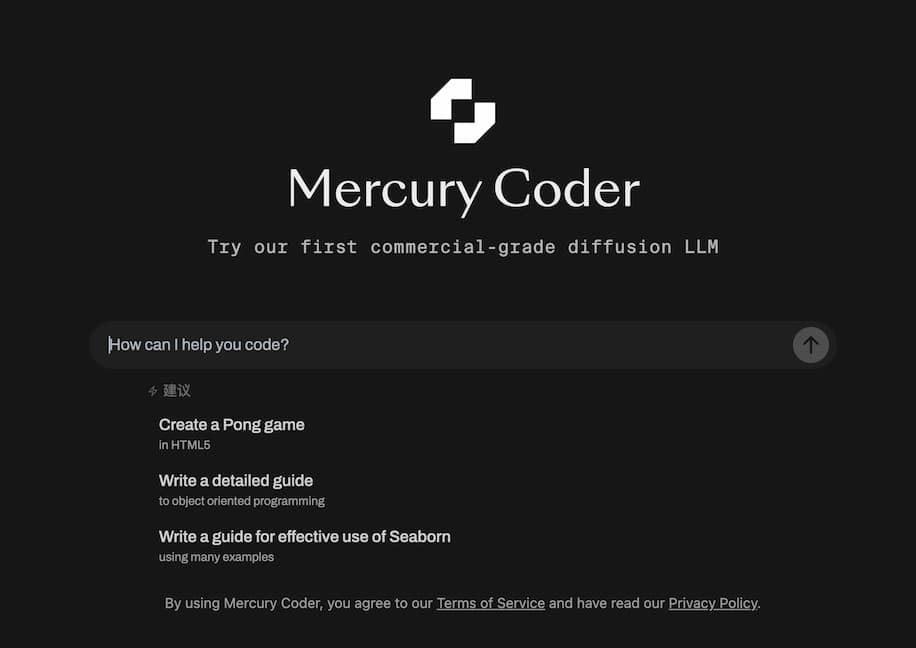

Mercury Coder est actuellement accessible gratuitement via le Playground en ligne d'Inception Labs ([https://chat.inceptionlabs.ai/). L'interface de la version d'essai est simple : entrez votre demande (par exemple, « Écrivez un simulateur JavaScript de billes rebondissant sur un billard »), et quelques secondes plus tard, vous obtenez le résultat, avec une prévisualisation du code ou du programme généré.

Par exemple :

Entrée : « Écrivez un simulateur pour 5 balles rebondissant sur une table de billard. Faites une physique de collision réaliste, sans gravité. Utilisez JavaScript. »

Résultat : un programme JavaScript complet est généré en quelques secondes, incluant la détection de collision physique et l'animation, avec une prévisualisation du simulateur en direct à droite.

Les retours utilisateurs indiquent que sa vitesse est vraiment impressionnante, surtout pour les prototypes rapides ou les scénarios nécessitant beaucoup de code. Cependant, certains utilisateurs sur X mentionnent que les réponses ne sont pas encore suffisamment matures et nécessitent plus de données d'entraînement pour améliorer la précision.

L'importance et l'avenir de Mercury Coder

Mercury Coder n'est pas seulement un nouvel outil, mais représente un changement de direction technologique :

- L'essor des modèles de diffusion : autrefois utilisés principalement pour les images et vidéos, ils prouvent leur efficacité dans le domaine du texte, ce qui pourrait déclencher une nouvelle course aux technologies de l'IA.

- Une révolution en termes d'efficacité : son avantage en vitesse et coût en fait un candidat idéal pour les appareils de bord (comme les téléphones ou ordinateurs portables) ou les déploiements à grande échelle.

- Des potentiels de nouvelles fonctions : grâce à son optimisation globale, il pourrait soutenir des raisonnements plus complexes, des corrections d'erreurs, voire des formats de sortie personnalisés.

Inception Labs affirme que Mercury Coder est le premier produit de la série « Mercury », avec des versions destinées à d'autres scénarios comme le chat (en test fermé) à venir. Cela signifie que son développement est juste au début.

Conclusion

Mercury Coder est un modèle d'IA basé sur la technologie de diffusion, se distinguant par sa vitesse ultra-rapide, sa qualité élevée et son coût réduit, particulièrement adapté à la génération de code et aux tâches nécessitant des contextes longs. Son fonctionnement ressemble à une magie « de flou à clair », bouleversant le modèle traditionnel de « génération pas à pas ». Bien que non encore parfait (par exemple, une polyvalence légèrement inférieure), il démontre un immense potentiel des modèles de diffusion dans le domaine du langage.

Si vous êtes un développeur souhaitant tester rapidement des idées de code, Mercury Coder mérite d'être essayé. Vous pouvez tester son Playground pour ressentir sa puissance « extrêmement rapide » ! Si vous désirez en savoir plus sur les détails techniques ou les cas d'utilisation, n'hésitez pas à me le faire savoir, je vous en parlerai plus en détail.

Sites connexes

Commentaires

Laisser un commentaire

Partagez vos pensées sur cette page. Tous les champs marqués d'un * sont obligatoires.